Вокруг темы искусственного интеллекта (ИИ) снова поднялась волна дискуссий. Их цель – помешать человечеству привести себя к апокалипсису в стиле «Терминатора». Однако все это сдерживает научные исследования и разработку новых технологий, что потенциально наносит вред обществу.  Потенциальные выгоды от использования искусственного интеллекта, такие как развитие машин и более эффективное производство, смогут революционизировать общество, если только мы сможем побороть свой страх. Об этом говорит директор Microsoft Research Крис Бишоп.

Потенциальные выгоды от использования искусственного интеллекта, такие как развитие машин и более эффективное производство, смогут революционизировать общество, если только мы сможем побороть свой страх. Об этом говорит директор Microsoft Research Крис Бишоп.

Существуют ли потенциальные риски?

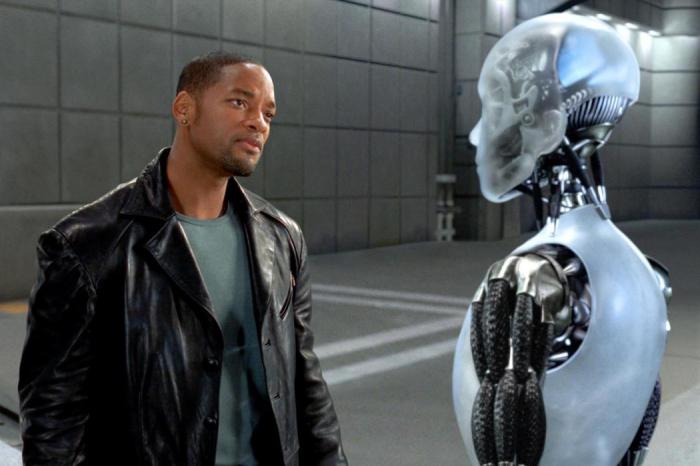

По его словам, общество слишком много внимания обращает на негативные аспекты ИИ, к примеру те, которые были изображены в фильме «Терминатор». Он говорит, что не согласен с громкими заявлениями людей, которые выступают против искусственного интеллекта, хотя признает, что потенциальные риски все же существуют.  Однако, по словам Бишопа, дело не в истреблении человечества, хотя именно этой версии развития событий чаще всего боятся. Вместо этого искусственный интеллект может развивать потенциально вредные пристрастия.

Однако, по словам Бишопа, дело не в истреблении человечества, хотя именно этой версии развития событий чаще всего боятся. Вместо этого искусственный интеллект может развивать потенциально вредные пристрастия.

Мнение известных общественных деятелей

Стивен Хокинг и Элон Маск публично признают риски, связанные с развитием искусственного интеллекта. Развитие полного ИИ может означать конец для человеческой расы - такое мнение высказал Хокинг в прошлом году.  В то же время Маск заявляет, что все мы должны быть очень осторожными с искусственным интеллектом. По его словам, именно в ИИ заключается наша самая большая экзистенциальная угроза. Не так давно Билл Гейтс также поддержал эту точку зрения.

В то же время Маск заявляет, что все мы должны быть очень осторожными с искусственным интеллектом. По его словам, именно в ИИ заключается наша самая большая экзистенциальная угроза. Не так давно Билл Гейтс также поддержал эту точку зрения.

Однако Бишоп говорит, что разговоры об искусственном интеллекте не помогут, если важные общественные деятели станут увековечивать эти идеи таким образом. Ранее он говорил о том, что Хокинг смотрит далеко в будущее.  Сам Крис Бишоп утверждает, что очень сложно делать прогнозы того, как будут развиваться технологии в следующие 10 лет. Что уж говорить о 1000-летнем сроке! Очевидно, что человечество столкнется со многими проблемами. Однако те же технологии могут иметь потенциал для решения этих проблем.

Сам Крис Бишоп утверждает, что очень сложно делать прогнозы того, как будут развиваться технологии в следующие 10 лет. Что уж говорить о 1000-летнем сроке! Очевидно, что человечество столкнется со многими проблемами. Однако те же технологии могут иметь потенциал для решения этих проблем.

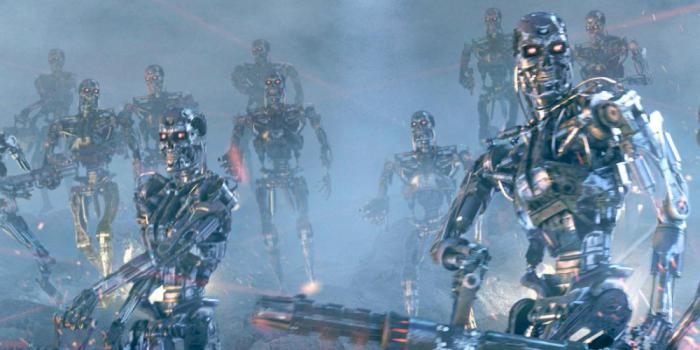

Роботы-убийцы

Справедливости ради нужно сказать, что боязнь развития ИИ имеет некоторые законные основания. В прошлом месяце увидел свет отчет "Хьюман Райтс Вотч", в котором ООН призывают запретить использовать роботов-убийц на войне, прежде чем они станут нормой. В докладе утверждается, что производство военных летательных беспилотных аппаратов, которые способны не только обнаружить, но и убить человека, может быть запущено всего спустя несколько лет. В ООН должны запретить их до того, как начнется их выпуск.

В докладе утверждается, что производство военных летательных беспилотных аппаратов, которые способны не только обнаружить, но и убить человека, может быть запущено всего спустя несколько лет. В ООН должны запретить их до того, как начнется их выпуск.