Не так давно ученым удалось выяснить один интересный факт: созданные ИИ лица могут выглядеть не менее реалистично, чем натуральные, а иногда даже и более правдоподобно. Такие лица, по словам экспертов, зачастую вызывают у пользователей Сети больше доверия и симпатии, чем естественные. Исследователи специально провели целую серию экспериментов, чтобы выяснить, могут ли поддельные лица, созданные машиной, обмануть людей.

ИИ и мошенники

Софи Дж. Найтингейл из Ланкастерского университета и Хани Фарид из Калифорнийского университета в Беркли рассказали о проведенном ими исследовании, в результате которого выяснилось, что ИИ способен создавать лица, кажущиеся людям более привлекательными, добрыми и открытыми, чем настоящие. Этим, по мнению ученых, могут воспользоваться, в том числе и разного рода темные личности. Ведь доброе, располагающее лицо на буклете с мошенническим призывом будет повышать степень доверия потенциальных жертв.

В своей работе ученые использовали лица, созданные генеративно-состязательной сетью StyleGAN2 от Nvidia. Работа таких сетей строиться на противопоставлении алгоритмов друг другу с целью создания представления о реальном мире.

Первые два эксперимента

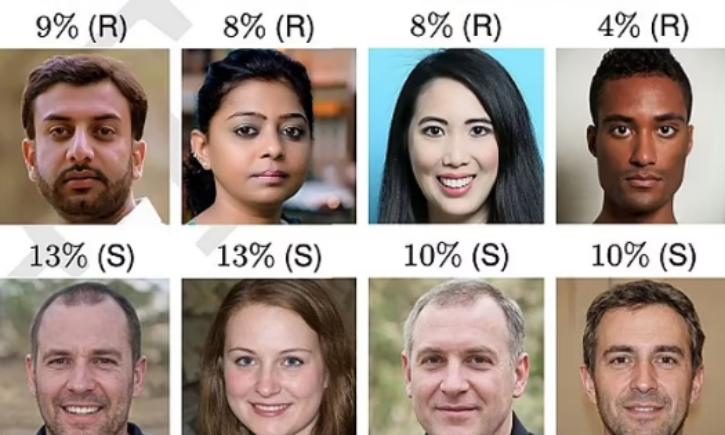

В первом эксперименте ученых приняло участие 315 человек. Испытуемым предложили оценить 128 лиц и определить, настоящие они или созданные машиной. Результаты показали точность в 48%. Это близко к 50%, то есть к обычному случайному угадыванию.

Во втором эксперименте 219 участников предварительно прошли короткое обучение по правильному поиску естественных и искусственно созданных лиц. Этим испытуемым в последующем также предложили 128 фото с тем же набором лиц, как и в первом эксперименте. Несмотря на обучение, уровень точности на этот раз повысился всего до 59%.

Третий эксперимент

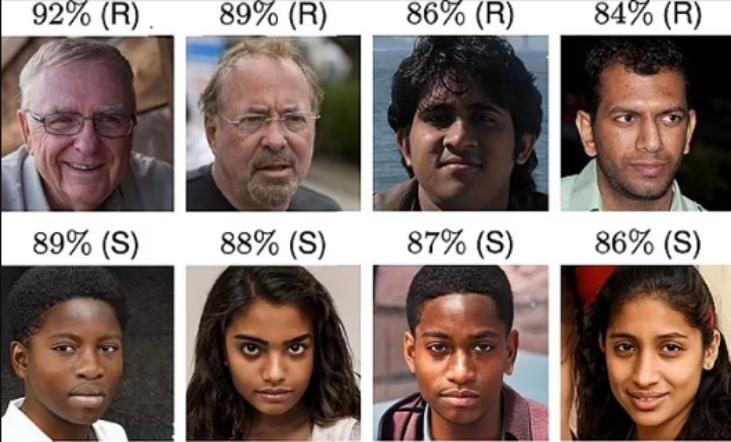

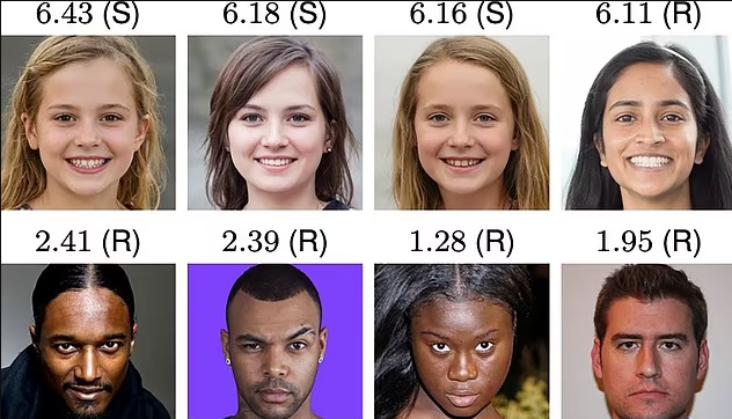

В третий раз ученые решили попросить испытуемых оценить вероятность естественности каждого из 128 лиц по шкале от 1 до 7. Затем исследователи сравнили результаты по натуральным лицам и созданным искусственно. Оказалось, что доверия к искусственным фото испытуемых было на 7.7% выше, чем к естественным.

При этом ученые выяснили, что участники эксперимента чаще признавали естественными лица чернокожих людей, даже, если они были созданы машиной. То же самое касается женщин. В большинстве случаев их лица признавались натуральными. Меньше всего доверия у испытуемых было к фото персонажей с азиатской внешностью. Многие участники признавали искусственными лица настоящих китайцев и японцев.

Наличие улыбки, хотя это достаточно важный фактор, на результаты испытуемых, по словам ученых, к их удивлению никак не влияло.

Дипфейки

Помимо обычных мошенничеств, по мнению ученых, использоваться искусственно созданные лица могут, к примеру, в дипфейках. Так называют видеоролики и фото, в которых одно лицо подменяется на другое. К примеру, обычному человеку подставляется голова знаменитости. Еще несколько лет назад такие имитации выглядели не слишком натурально и вызывали лишь смех. Сегодня технология создания дипфейков значительно эволюционировала.

Искусственный интеллект и этика

Чтобы защитить пользователей Сети от обмана и мошенничества, связанных с дипфейками, проводившие эксперимент ученые предложили обязать создателей искусственных лиц и площадки, распространяющие такой синтезированный контент, включать в него специальные водяные знаки.

По мнению исследователей, это позволило бы пользователям интернета сразу же идентифицировать фото, созданные ИИ, как синтезированные и ненастоящие. Ученые выразили надежду на то, что те представители сферы IT, которые в своей работе напрямую соприкасаются с продуктами, созданными «думающими» машинами, уже сейчас начнут вырабатывать определенные этические нормы. Такие нормы позволят сохранить во Всемирной сети существующий порядок и полную безопасность участников.